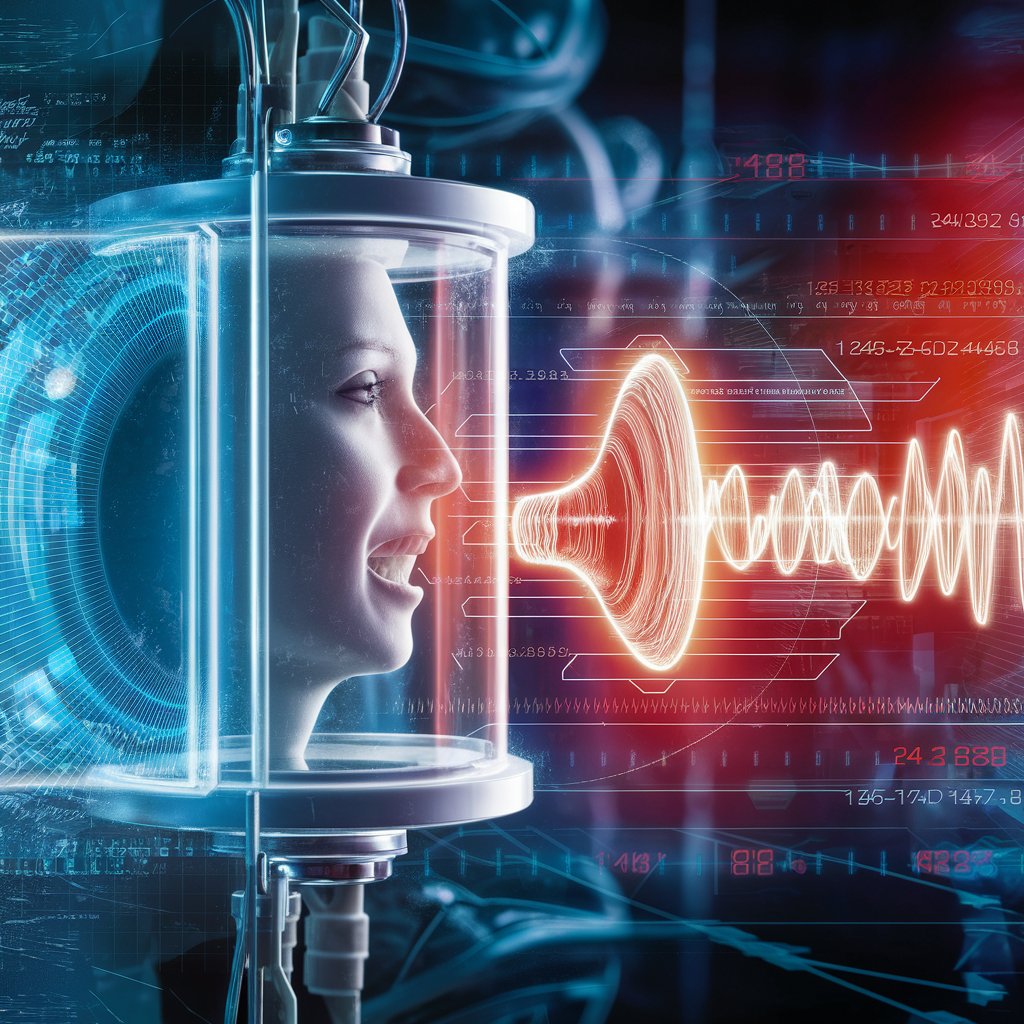

VALL-E 2 to nowo powstający generator AI od Microsoftu, który miał być innowacyjnym narzędziem do klonowania głosu. W prosty sposób model sztucznej inteligencji przetwarza tekst na mowę. Ostatnio zostały przeprowadzone testy przez inżynierów i wyniki okazały się niesamowicie zadowalające.

Microsoft ogłosił, że VALL-E 2 potrafi wygenerować głos, osiągającym parytet ludzki. Innymi słowy – próbki nie są sztuczne, a bardzo rzeczywiste i w stopniu tak wiarygodnym, że nie można go rozróżnić od ludzkiego. Jest się z czego cieszyć? Otóż – nie do końca.

VALL-E 2 zbyt dobry, aby go wydać?

VALL-E 2 z racji swojego zaawansowania może zostać uśmierconym projektem. Twórcy boją się go upublicznić w obawie o wykorzystanie w niecnych celach. Microsoft tworząc nowe narzędzie miał oczywiście dobre intencje. Widział wykorzystanie w branży edukacyjnej, rozrywce, dziennikarstwie, treściach autoryzowanych, funkcjach dostępności, interaktywnych systemach reagowania głosowego, czy tłumaczeniach. Jak widać, wyniki okazały się zbyt doskonałe niż pierwotnie zakładano.

Raport wykazuje, że wygenerowany głos jest krystalicznie czysty – nawet w przypadku zdań, które tradycyjnie stanowią wyzwanie ze względu na ich złożoność lub powtarzające się frazy. Inne narzędzia, które są dostępne na rynku – owszem – mogą również stworzyć głos podobny do człowieka, jednak sprawne ucho dostrzeże pewne niuanse, świadczące o fejku. I tutaj warto zaznaczyć, że wokal „jest podobny do człowieka”. VALL-E 2 generuje takie próbki, których nie można odróżnić.

Witamy w świecie niebezpiecznej AI

Cieszy podejście Microsoftu, bo nie jest tajemnicą, że na Świecie mają już miejsce oszustwa, związane z wygenerowanym głosem. Korporacja nie zamierza upubliczniać swojego nowego narzędzia, aczkolwiek samo jego istnienie budzi kontrowersje. Czy taki klon mowy (szczególnie, że powszechnie wiadomo, że powstał) nie powinien zostać totalnie anulowany? Nie chcę siać fatalizmu, ale to całkiem niezły cel hakerów. Nie możemy również wykluczyć nielegalnego upublicznienie kodu przez osoby wewnątrz firmy, które mogłyby się sporo dorobić na takim występku.

Sztuczna inteligencja ma pomagać ludziom. Chciałbym, aby większość ludzi miała podobne zdanie co ja. Nie ukrywajmy jednak, że AI robi się coraz bardziej niebezpieczna. Narzędzia są coraz bardziej profesjonalne, a użytkownicy nie zawsze postępują etycznie. Upublicznie VALL-E 2 na pewno nie byłoby dobrym pomysłem. Przetrzymywanie jego kodu w zasobach firmy też jest niebezpieczne.

Jednak obawiam się, że jak nie Microsoft to inna korporacja wcześniej czy później nie będzie miała oporów, aby wydać równie potężny model AI. Wniosek z tego jeden – trzeba być zawsze czujnym i nie wierzyć we wszystko, co zobaczymy, lub tez usłyszymy.

Żródło: New York Post